La importancia de la confianza de los clientes en Copilot

Es vital transmitir cómo funcionan las tecnologías como Copilot para fomentar la confianza entre los clientes finales.

En el ámbito de la IA, la claridad genera confianza. Es sumamente importante transmitir cómo funcionan las tecnologías de inteligencia artificial generativa como Copilot, no sólo para aprovecharlas eficazmente, sino también para fomentar la confianza entre los clientes finales. Por lo tanto, es importante que eduquemos a los clientes finales aprovechando dos recursos que explican de forma excelente y sencilla el funcionamiento de Microsoft Copilot:

Vídeo de YouTube sobre cómo funciona Copilot y la IA responsable

Este vídeo de YouTube explica de forma fácil de entender cómo funciona Copilot, explicando su arquitectura y cómo se aplican los principios de la IA responsable. Es perfecto para cualquiera que quiera comprender rápidamente cómo funciona Copilot.

Creando confianza digital en Microsoft Copilot para Dynamics 365 y Power Platform

En Microsoft, la confianza es la base de todo lo que hacen. A medida que más organizaciones adoptan Copilot en Dynamics 365 y Power Platform, se comprometen a ayudar a todos a utilizar la IA de forma responsable. Para ello, Microsoft se asegura de que sus productos de IA ofrezcan los más altos niveles de seguridad, cumplimiento y privacidad de acuerdo con su Responsible AI Standard, el framework para el despliegue seguro de las tecnologías de IA.

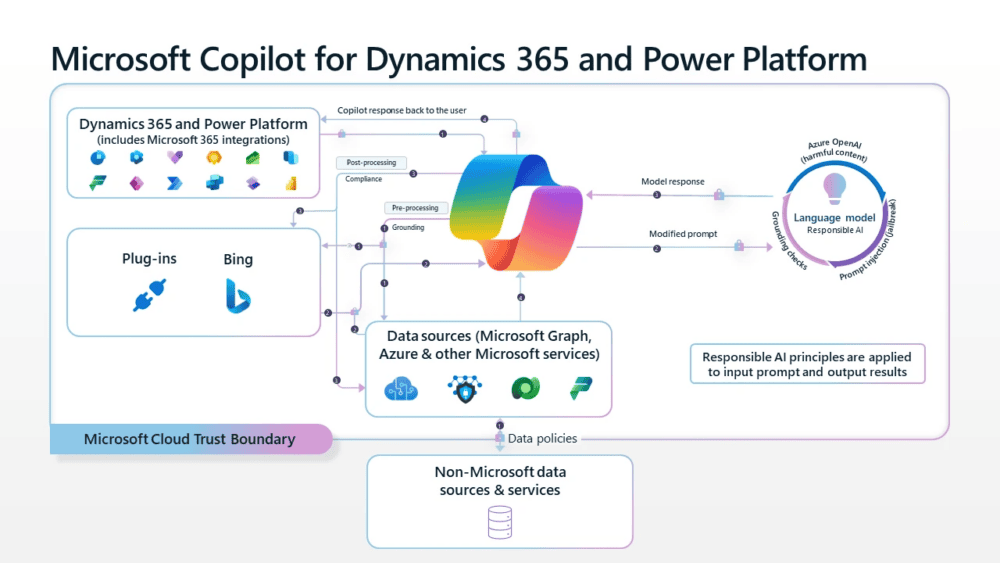

Arquitectura de Copilot y principios de IA responsable en acción

Empecemos por cómo funciona Copilot, cómo protege los datos de tu empresa y cumple los requisitos de privacidad, y cómo utiliza la IA generativa de forma responsable.

En primer lugar, Copilot recibe un prompt de un usuario de Dynamics 365 o Power Platform. Este prompt puede ser en forma de una pregunta que el usuario escribe en un panel de chat, o una acción, como seleccionar un botón etiquetado como «Crear un email.»

Copilot procesa el prompt utilizando un enfoque denominado grounding, que puede incluir la recuperación de datos de Microsoft Dataverse, Microsoft Graph o fuentes externas. El grounding mejora la relevancia del prompt, de modo que el usuario obtiene respuestas más adecuadas a su tarea. Las interacciones con Copilot son específicas de cada usuario. Esto significa que Copilot sólo puede acceder a los datos para los que el usuario actual tiene permisos.

Copilot utiliza Azure OpenAI Service para acceder a potentes modelos generativos de IA que comprenden las entradas de lenguaje natural y devuelven una respuesta al usuario en la forma adecuada. Por ejemplo, la respuesta puede ser un mensaje de chat, un correo electrónico o un gráfico. Los usuarios siempre deben revisar la respuesta antes de emprender cualquier acción.

Cómo utiliza Copilot sus datos empresariales patentados

Las respuestas se basan en el contenido y los datos de su empresa. Copilot tiene acceso en tiempo real tanto a su contenido como a su contexto para generar respuestas precisas, relevantes y ancladas en sus datos empresariales para mayor precisión y especificidad. Este acceso en tiempo real se realiza a través de la plataforma Dataverse (que incluye todos los conectores de Power Platform), respetando las políticas de prevención de pérdida de datos y otras políticas de seguridad establecidas por su organización. Microsoft sigue el modelo de generación mejorada por recuperación (RAG), que aumenta las capacidades de los modelos lingüísticos añadiendo datos de base dinámicos al prompt que enviamos al modelo. Nuestro sistema busca dinámicamente el esquema de datos pertinente utilizando nuestros propios índices de incrustación y, a continuación, utiliza los modelos lingüísticos para ayudar a traducir la pregunta del usuario en una consulta que podamos ejecutar en el sistema de registro.

No utilizan sus datos para entrenar modelos lingüísticos. Microsoft considera que los datos de los clientes son sus datos, de acuerdo con la política de privacidad de datos de Microsoft. Los modelos lingüísticos basados en IA se entrenan en un corpus de datos grande pero limitado, pero los prompts, las respuestas y los datos a los que se accede a través de Microsoft Graph y los servicios de Microsoft no se utilizan para entrenar las capacidades de Copilot para Dynamics 365 o Power Platform para su uso por parte de otros clientes. Además, los modelos no se mejoran con su uso. Esto significa que solo pueden acceder a sus datos los usuarios autorizados de tu organización, a menos que consienta explícitamente otro acceso o uso.

Cómo protege Copilot la información y los datos empresariales

IA de nivel empresarial, impulsada por Azure OpenAI Service. Copilot funciona con el servicio Azure OpenAI Service, que ofrece funciones de seguridad sólidas y de nivel empresarial. Estas funciones incluyen el filtrado de contenidos para identificar y bloquear la salida de contenidos nocivos y proteger contra prompt injections (ataques de fuga de información), que son prompts de usuario que provocan que el modelo generativo de IA se comporte de formas para las que ha sido entrenado. Los servicios de Azure AI están diseñados para mejorar la gobernanza y la privacidad de los datos y se adhieren a las estrictas normas de protección de datos y privacidad de Microsoft. Azure OpenAI también es compatible con funciones empresariales como Azure Policy y las recomendaciones de seguridad basadas en IA de Microsoft Defender for Cloud, cumpliendo los requisitos de conformidad con claves de cifrado de datos gestionadas por el cliente y sólidas funciones de gobernanza.

Construido sobre el enfoque integral de Microsoft para la seguridad, la privacidad y el cumplimiento. Copilot está integrado en Microsoft Dynamics 365 y Power Platform. Hereda automáticamente todas las políticas y procesos de seguridad, cumplimiento y privacidad de su empresa. Copilot está alojado dentro de Microsoft Cloud Trust Boundary y se adhiere a prácticas de cumplimiento, seguridad y privacidad exhaustivas y líderes del sector. El tratamiento de los datos de Copilot es idéntico al que Microsoft da a los datos de otros clientes, lo que le da total autonomía para decidir si desea conservar los datos y determinar los elementos de datos específicos que desea conservar.

Salvaguardados por múltiples formas de protección. Los datos de los clientes están protegidos por varias tecnologías y procesos, incluidas varias formas de cifrado. Las conexiones están protegidas con Transport Layer Security (TLS), y las transferencias de datos entre Dynamics 365, Power Platform y Azure OpenAI se producen a través de la red troncal de Microsoft, lo que garantiza tanto la fiabilidad como la seguridad. Copilot utiliza protocolos de transporte seguro estándar del sector cuando los datos se mueven a través de una red, entre dispositivos de usuario y centros de datos de Microsoft o dentro de los propios centros de datos.

La fuga de datos preocupa a los clientes. Los modelos de IA de Microsoft no se entrenan ni aprenden de los datos de sus tenants ni de sus prompts a menos que el administrador de su tenant haya optado por compartir los datos con ellos. Dentro de su entorno, se pueden controlar los accesos a través de los permisos que se configuren. Los mecanismos de autenticación y autorización segregan las solicitudes al modelo compartido entre los inquilinos. Copilot utiliza datos a los que sólo tu puede acceder. Tus datos no están disponibles para otros.

Comprometidos con la creación responsable de IA

A medida que tu organización explora Copilot para Dynamics 365 y Power Platform, Microsoft se compromete a ofrecer los más altos niveles de seguridad, privacidad, cumplimiento y compromisos normativos, ayudándote a transformarte en un negocio impulsado por la IA con confianza.

Información basada en la publicación del blog de Dynamics 365: «Building digital trust in Microsoft Copilot for Dynamics 365 and Power Platform» publicado por Donald Kossman (Distinguished Engineer, VP Business Copilot AI @ Microsoft).