Guía oficial de prompt engineering de OpenAI

OpenAI ha compartido su propia guía de Prompt Engineering.

Los «prompts» y el «prompt engineering«

Un prompt es una instrucción o una solicitud que se le da a un modelo de lenguaje de inteligencia artificial para que genere una respuesta específica. En otras palabras, es el texto o la pregunta que un usuario proporciona para obtener una respuesta del modelo de lenguaje.

El Prompt Engineering, o «Ingeniería de prompts» en español, se refiere al proceso de diseñar y formular adecuadamente los prompts para obtener respuestas deseadas de un modelo de lenguaje. Implica la selección de palabras clave, la estructura de la frase y otros elementos que ayuden a guiar al modelo hacia la generación de respuestas precisas y útiles. El Prompt Engineering es una técnica importante para aprovechar al máximo la capacidad de un modelo de lenguaje y garantizar que las respuestas sean relevantes y coherentes con la solicitud del usuario. En resumen, se trata de cómo se «instruye» al modelo para obtener la respuesta deseada.

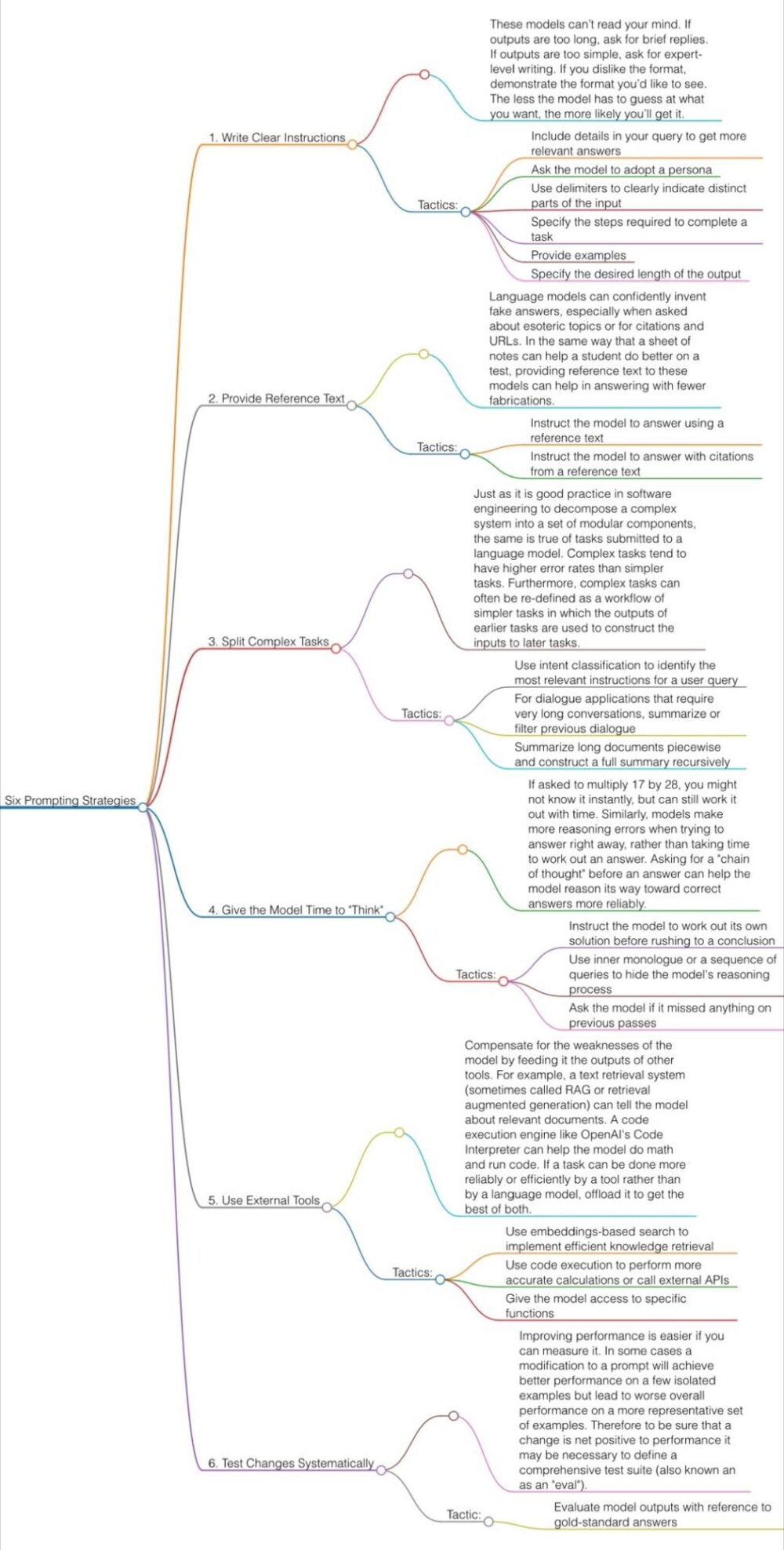

El prompt engineering de OpenAI resumido en una imagen

Las 6 estrategias del prompt engineering de OpenAI

Se puede resumir en 6 grandes estrategias, que a su vez tienen tácticas específicas, y son estas:

1. Escribir instrucciones claras

Especificar lo más posible el tipo o formato de respuesta que quieres. Esto incluye:

- Pedir al modelo que adopte un rol determinado («Eres un…»)

- Delimitar partes o secciones que debe tener la respuesta

- Especificar los pasos necesarios para responder

- Dar detalles y ejemplos de respuestas correctas

- Especificar la extensión de la respuesta

2. Aportar documentación y textos de referencias

- Pedir el texto de referencia al modelo

- Pedir citas

3. Dividir las tareas complejas en otras más sencillas

Esto incluye dar ejemplos de cada grupo cuando le pides que clasifique o agrupe cadenas de texto.

- Clarificar intenciones

- Resumir tareas largas

- Proporcionar resúmenes

4. Dar al modelo tiempo para pensar

Pide que revise si la solución a la que ha llegado es correcta.

- Instruye al modelo para que se tome su tiempo

- Pide que cometa errores

Prueba lo siguiente:

- «tómate tu tiempo, trabaja paso a paso»

- «esto me importa mucho, por favor»

- «te daré una propina de 200 euros»

5. Usar herramientas externas

Para determinadas tareas, pedir al modelo que use embeddings, una función específica de código o que se conecte a la API adecuada dará siempre mejores respuesta que dejar que el modelo trabaje sin herramientas.

6. Probar los cambios de manera sistemática

Para saber si estamos consiguiendo la mejor respuesta posible necesitamos medirlo y hacer cambios de manera sistemática.

Esta información está basada en la guía oficial de OpenAI de Prompt engineering, la página de ejemplos de prompts: Prompt examples, una publicación en LinkedIn de Mark Rascher y una publicación en X de Juan González Villa.