Herramientas IA no supervisadas y las fugas de información

El uso de herramientas de IA generativa no supervisadas en el entorno laboral está en auge, pero ¿a qué precio?

Según datos de Microsoft y LinkedIn, el 77% de los empleados usa IA por su cuenta, lo que aumenta los riesgos de fugas de información y brechas de seguridad.

Principales desafíos de seguridad en la adopción de la IA

IA: preocupaciones y retos

Más del 80% de los directivos considera que el potencial de fuga de datos confidenciales es su principal preocupación. Existe una necesidad real de que las organizaciones mejoren la visibilidad y el control de su activo más crítico: los datos.

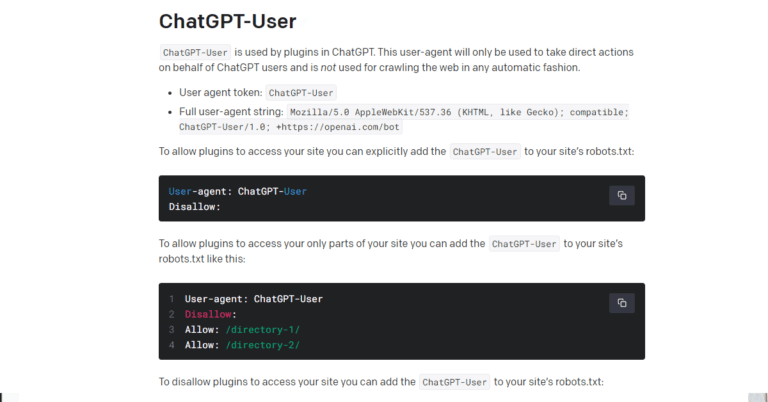

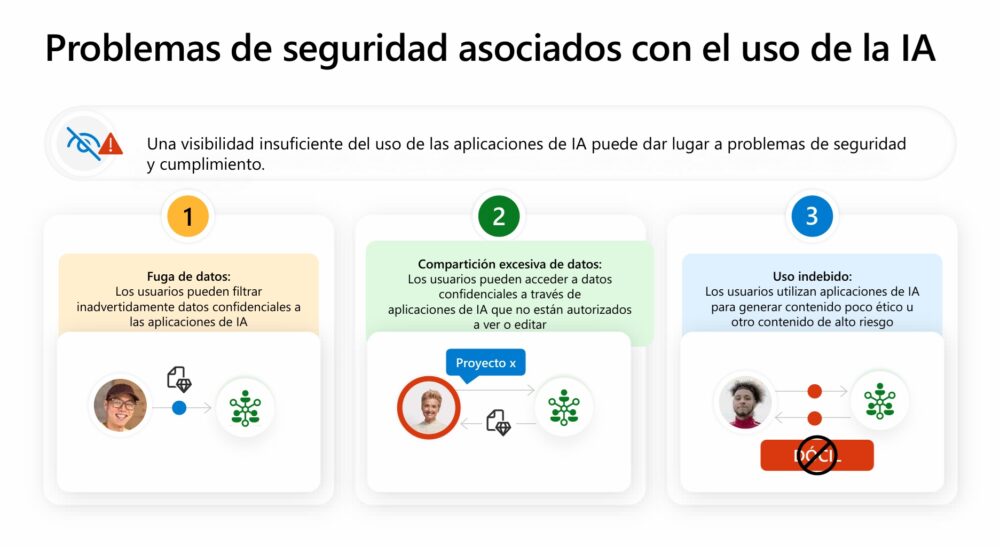

A pesar de ello, muchas empresas desconocen el uso de aplicaciones de IA por parte de sus empleados. Esto incluye información sobre qué aplicaciones se utilizan, quiénes las usan y qué tipos de datos se comparten o generan. La falta de visibilidad puede derivar en desafíos de seguridad y cumplimiento que, a su vez, pueden provocar incidentes como:

- Fugas de datos: Los usuarios pueden revelar involuntariamente datos confidenciales, como información personal de clientes, a aplicaciones de IA que incorporen esa información a su conocimiento, haciéndola pública de facto.

- Uso compartido de datos: Los usuarios podrían intentar acceder a información sensible a través de aplicaciones de IA. Sin controles de seguridad adecuados, estas aplicaciones podrían obtener acceso, resumir o crear contenido basado en datos confidenciales, incrementando el riesgo de sobreexposición.

- Uso indebido: Con la facilidad de creación de contenido mediante IA generativa, los usuarios pueden generar contenido poco ético o de alto riesgo, como noticias falsas o información fraudulenta. Es esencial que las organizaciones regulen el uso de aplicaciones de IA para garantizar el cumplimiento de códigos de conducta y requisitos normativos.

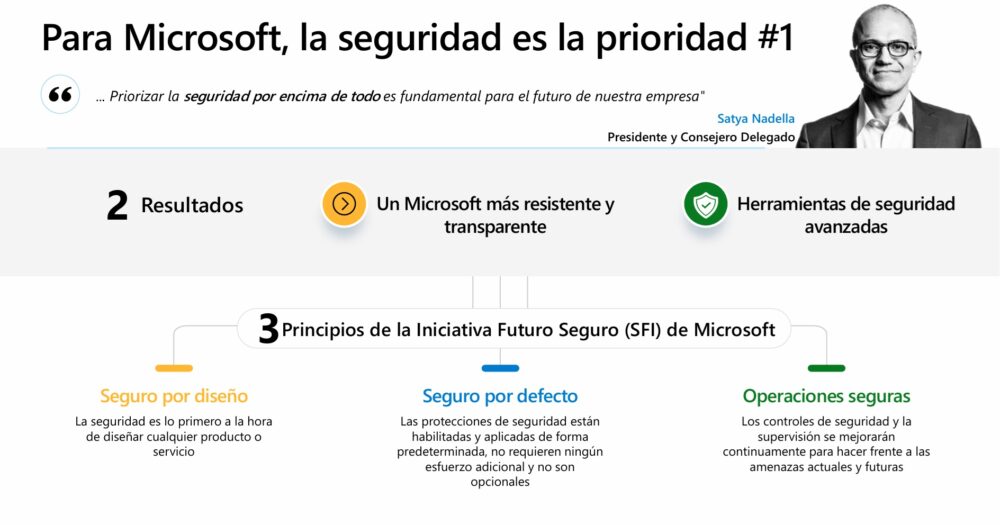

La seguridad por encima de todo

En noviembre de 2023, Microsoft lanzó la Iniciativa Futuro Seguro, priorizando la seguridad por encima de todo. Esta iniciativa, transversal a toda la compañía, fue diseñada para asegurar que se cumplan los estándares más altos de Seguridad para maximizar la protección de todos los clientes. La iniciativa se basa en tres principios fundamentales:

- Seguridad por diseño: La seguridad es prioritaria en el diseño de cualquier producto o servicio.

- Seguridad de forma predeterminada: Las protecciones de seguridad están habilitadas por defecto, sin requerir ningún esfuerzo adicional.

- Operaciones seguras: Los controles de seguridad y la supervisión se mejoran continuamente para hacer frente a amenazas actuales y futuras.

Información basada en la publicación oficial de Microsoft: «Fugas de información: el desafío de las empresas ante el uso de herramientas de IA no supervisadas«.